被封杀当晚,OpenAI 拿到了相同条款——Amodei 首次专访揭开 Anthropic 与五角大楼冲突内幕

宝玉

2026 年 2 月 27 日,对 Anthropic 来说是漫长的一天。

这天下午,特朗普在 Truth Social(他旗下的社交平台)上发帖,称 Anthropic 是“左翼疯子”运营的公司,命令所有联邦机构“立即停止”使用 Anthropic 的技术。几乎同时,国防部长 Pete Hegseth 在 X 上宣布将 Anthropic 定性为“国家安全供应链风险”——这个标签此前只用过两次,一次给了与俄罗斯政府有关联的卡巴斯基实验室,一次给了外国芯片供应商。从未用于一家美国公司。

当晚,Anthropic CEO Dario Amodei 接受了 CBS News 的独家专访。这是事件发生后他第一次面对镜头。在近 30 分钟的对话中,他谈到了与五角大楼谈判破裂的始末,包括 3 天最后通牒、充满模糊法律术语的“妥协”条文,以及他为什么坚持两条红线不可让步。他将政府的行动定性为“报复性和惩罚性的”,并表示将在法庭上挑战供应链风险认定。

原始视频链接:http://www.youtube.com/watch?v=MPTNHrq_4LU

原始视频链接:http://www.youtube.com/watch?v=MPTNHrq_4LU

以下是访谈核心内容。

要点速览

-

Anthropic 同意五角大楼 98%-99% 的使用场景,争议仅涉及两条红线:国内大规模监控和全自主武器。据 Amodei 称,这些限制从未在实际军事任务中被触发过。

-

五角大楼给了 Anthropic 3 天最后通牒,期间发来的“妥协”语言充满“如果五角大楼认为适当”等模糊条款,实际未做出实质让步。

-

供应链风险认定此前从未用于美国公司,仅用于卡巴斯基(Kaspersky,俄罗斯)和外国芯片供应商等外国对手。Amodei 称这一措施“报复性和惩罚性的”。

-

截至采访时,Anthropic 未收到任何正式政府通知,所有信息来自特朗普和 Hegseth 的社交媒体帖子。Anthropic 将在法庭上挑战这一认定。

-

就在 Anthropic 被封杀数小时后,OpenAI 宣布与五角大楼达成协议,声称包含了完全相同的两条红线限制。这暗示争端的核心可能是谁拥有最终解释权。

【1】98% 的使用场景早已开放,争议只在那 2%

采访者开门见山:“为什么不向美国政府无限制开放 Anthropic 的 AI?”

Amodei 的回答从一个可能出乎许多观众意料的事实开始:Anthropic 在所有 AI 公司中与美国政府的合作最为积极。他说 Anthropic 是第一家将模型部署到军方保密云(classified cloud)的公司,第一家为国家安全目的定制模型的公司,目前已在情报界和军方广泛部署,涵盖网络安全、战斗支援等多个领域。

【注:2025 年 7 月,Anthropic 通过与 Palantir 的合作,与五角大楼签订了价值 2 亿美元的合同,成为首家在军方保密系统中部署前沿 AI 模型的公司。OpenAI 和 Google 同期也获得了国防部合同,但此前仅在非保密网络中使用。】

在这个前提下,Amodei 说 Anthropic 对五角大楼提出的 98% 到 99% 的使用场景都没有异议。例外只有两项:国内大规模监控(mass domestic surveillance)和全自主武器(fully autonomous weapons)。

在保卫自己免受外部威胁的同时,我们必须以捍卫民主价值观的方式来做这件事。

(”As we defend ourselves against our adversaries, we have to do so in ways that defend our democratic values and preserve our democratic values.”)

【2】两条红线:技术超前于法律,AI 让此前不可能的事变成了可能

Amodei 逐一解释了两条红线的逻辑。

第一条红线是国内大规模监控。 他举了一个具体的例子:私人公司收集的美国人位置数据、个人信息、政治归属等,政府可以合法购买这些数据,然后用 AI 进行大规模分析。关键在于,这种做法在法律上并不违法。在 AI 时代之前,这种分析因为技术限制而不实用,所以法律从未需要覆盖这种场景。Amodei 的核心论点是:技术的发展速度已经超过了法律的更新速度,第四修正案的司法解释和国会立法都还没有追赶上来。

【注:这并非理论推演。2025 年,有报道显示 ICE(美国移民和海关执法局)已使用 Clearview AI 等面部识别工具,以及 NEC 的 Mobile Fortify 系统来追踪个人。ICE 最大的承包商 Geo Group 在 2025 年获得超过 8 亿美元合同,用于从商业数据库中挖掘数据并对嫌疑人进行实地监控。】

第二条红线是全自主武器。 Amodei 特别强调,他不是在说乌克兰战场上已经使用的半自主武器,而是完全没有人类参与的武器系统。但他并不绝对反对全自主武器的存在,承认“我们的对手可能某天会拥有它们,也许民主防御终将需要它们”。他提出两个现实担忧。

第一个是技术可靠性。 Amodei 说,任何使用过 AI 模型的人都知道,这些系统存在基本的不可预测性,“从纯技术角度来看,我们还没有解决这个问题”。他不想卖一个不够可靠的产品,不想因此导致己方人员或无辜平民丧命。

第二个是监督机制的缺失。 他描绘了一个具体场景:如果有一支 1000 万架无人机组成的军队,由一个人或少数人协调控制,没有人类士兵在现场做关于“对谁开火”的决定,这种权力集中程度前所未有,现有的问责链条完全失效。“我们需要就谁来按按钮、谁有权说不进行讨论,而我们还没有进行这个讨论。”

Amodei 还透露,Anthropic 曾主动提出与五角大楼合作研发全自主武器技术——在沙盒环境中原型化——“但他们不感兴趣,除非从一开始就能想做什么就做什么”。

【3】谈判破裂的内幕:3 天最后通牒与表面妥协

采访者带来了五角大楼方面的说法:“五角大楼告诉我们,他们已原则上同意这两项限制,并希望达成协议。为什么无法达成?”

Amodei 首次披露了谈判细节。五角大楼给了 Anthropic 3 天最后通牒:要么同意他们的条件,要么被列为供应链风险或面临《国防生产法》(Defense Production Act)的强制征用。

在这 3 天里有过几轮交换。五角大楼某一时刻发来了一版条文,表面上似乎满足了 Anthropic 的条件,但 Amodei 说仔细看后发现充满了“如果五角大楼认为适当”、“或按照法律规定做任何事”等模糊表述。“它实际上没有在任何有意义的层面上做出让步。”

这与 ABC News 获得的信息相吻合。据报道,Anthropic 告诉 ABC News,五角大楼最新的合同语言“在防止 Claude 被用于大规模监控美国人或完全自主武器方面几乎没有进展”。所谓的“新语言”被“法律术语配套”,“允许这些安全措施被随意忽略”。

他引用了五角大楼首席发言人 Sean Parnell 在截止日前一天的推文作为佐证——Parnell 重申了五角大楼的立场:“我们只允许所有合法用途(all lawful use)。” 这恰恰是他们从一开始就在坚持的措辞,与所谓的“原则上同意”形成了鲜明矛盾。

【注:Sean Parnell 是特朗普政府任命的五角大楼首席发言人暨国防部长高级顾问。在谈判期间,另一位关键角色是国防部研究与工程副部长 Emil Michael(前 Uber 高管),他曾在社交媒体上公开称 Amodei 是”骗子”,并指控他有”上帝情结”(God complex),试图”亲自控制美国军队”。】

【4】回应特朗普”自私”指控:即使被封杀也承诺帮助过渡

采访者读出了特朗普当天在 Truth Social 上的帖子:“他们的自私正在将美国人的生命置于危险之中,将我们的军队置于危险之中,将我们的国家安全置于危险之中。”

【注:特朗普当天完整帖子的语气更为激烈,称 Anthropic 是“左翼疯子”(leftwing nut jobs),指控其试图“强迫战争部遵守他们的服务条款而非宪法”,并下令所有联邦机构“立即停止”使用 Anthropic 技术。】

面对这一指控,Amodei 没有反击措辞,而是强调了一个具体承诺:即使在被采取这些前所未有的措施之后,Anthropic 仍然愿意做一切能做的事来支持五角大楼——提供技术支持,直到军方完成过渡、换用其他供应商。

采访者追问:“你准备好退出了?”

Amodei 说他对服务中断深感担忧。他提到自己与一线穿制服的军事人员交流过,对方告诉他,失去 Claude 将使他们倒退 6 到 12 个月,甚至更长。“这就是为什么我们如此努力地想达成协议。但 3 天的最后通牒、供应链风险认定的威胁——整个时间线都是五角大楼驱动的,不是我们。”

【5】AI 时代的权力边界:谁有权给 AI 军事应用画线?

采访者切入了这场争端最根本的问题:“为什么你认为 Anthropic——一家私营公司——比五角大楼更有权决定 AI 如何在军事中使用?”

Amodei 先澄清了一个事实:据他所知,一线实际使用中从未触发过这些限制。这是 1% 的使用场景,而且目前没有证据表明有人真的需要做这些事。

然后他做了一个关键的让步——“我实际上同意你的观点。”他认为,长期而言,这确实应该是国会的职责。AI 让政府可以大规模分析美国人的位置数据、个人信息和政治归属,而这在法律上并不违法,这说明法律需要更新。

但国会不是世界上行动最快的机构。在立法到来之前,Amodei 认为最了解技术前沿的人有责任暂时充当守门人。他用两个问题框定了这场争论的本质:

没有人想被美国政府监控。没有人想被美国政府监控。

(“No one wants to be spied on by the US government. No one wants to be spied on by the US government.”)

这些是根本性的权利——不被政府监视的权利,军人(而非机器)做战争决策的权利。

采访者继续追问:“但以基本原则之名,为什么美国人应该信任你——一个私营公司 CEO——来做这些决定,而不是联邦政府?”

Amodei 的回答分两层。第一层是市场逻辑:Anthropic 是一家私营公司,有权选择卖什么、怎么卖。如果政府不满意,完全可以换一个供应商。他说如果五角大楼说“Dario,我们理念不合,我们去找别的模型”,他会不同意但会尊重。这才是处理此类分歧的正常方式。

但政府没有这样做。第二层是他对惩罚性措施的控诉:政府不仅取消了五角大楼的合同,还将惩罚范围扩大到五角大楼以外的政府部门,试图在惩罚意义上撤销更广泛的政府合同,并且做出了供应链风险认定,这意味着任何有军事合同的私营公司在军事合同部分不能使用 Anthropic。“这很难用惩罚以外的任何方式来解释。”

【注:参议院军事委员会的高级参议员们在最后通牒到期前写了一封私人信函给 Anthropic 和五角大楼,敦促双方和解。信中表示国防部“无意进行大规模监控或在没有人类参与的情况下使用自主武器——这些立场我们在国会也支持”,但也承认“合法使用”的问题“需要所有利益相关方进一步努力”。】

【6】跟卡巴斯基和华为归为一类——“感觉非常惩罚性和不公正”

Amodei 说,据他所知,供应链风险认定从未被用于美国公司。此前被列入这一名单的包括卡巴斯基实验室(一家与俄罗斯政府有嫌疑关联的网络安全公司)和外国芯片供应商。

被跟这些公司归为一类,考虑到我们为美国国家安全所做的一切,这感觉非常惩罚性和不公正。

(“Being lumped in with them, it feels very punitive and inappropriate given the amount that we've done for US national security.”)

【注:2024 年,美国商务部禁止卡巴斯基实验室在美国提供杀毒服务,理由是俄罗斯政府的网络战能力对其运营构成威胁。此前的供应链风险认定均针对与外国政府有关联的企业——将同一机制用于美国本土公司确实是前所未有的。】

【7】波音不会告诉军方怎么用飞机——AI 为什么不同?

采访者提出了一个有力的类比:“波音为美国军方建造飞机,但波音不会告诉军方怎么使用那架飞机。这有什么不同?”

Amodei 用两个层面回应。首先是技术成熟度的差异。飞机已经存在很久了,将军们对飞机的工作原理有相当成熟的理解。但 AI 正在以前所未有的速度推进——模型的计算量每四个月翻一倍。“我们从未见过这样的创新速度。”

采访者立刻反驳:“如果这种速度持续下去,美国政府永远追不上。那你的逻辑不是自相矛盾吗?你一方面说要跟政府合作保障国家安全,一方面又说技术太快了政府跟不上。”

Amodei 的回应是:国会只需要追赶一次。技术速度快,但需要国会介入的议题很少且非常具体——就是国内大规模监控和全自主武器这两个。一旦立法框架建立,就不需要反复更新。

他把论证收束到一个核心问题上:“为什么要纠结那 1% 有违我们价值观的使用场景,而不是去推进 99% 有利于民主价值观、能够保卫这个国家的使用场景?我们甚至愿意研究那最后 1%,看看有没有办法以符合我们价值观的方式去做。”

【8】如果全自主武器出错了:误杀平民与 1000 万架无人机的问责难题

采访者追问:“给我举一两个例子,说明什么可能出错。”

Amodei 描述了两类风险。第一类是可靠性风险:AI 瞄错目标、射杀平民、缺乏人类士兵的判断力,导致友军误伤或无辜伤亡。“我们不想卖一个我们认为不够可靠的东西,不想卖一个可能导致我们自己人被杀或无辜者被杀的东西。”

第二类是监督风险。 他让观众想象一个场景:一支 1000 万架无人机组成的军队,由一个人或少数人协调控制。人类士兵有一整套问责链条,建立在每个人运用常识判断的基础上。当你把所有决策集中到极少数人手里,这套机制就崩溃了。

他再次强调,自己并不是说永远不应该有这样的无人机舰队——“也许某天我们需要它,因为我们的对手会有”——但必须先讨论问责机制。“谁在按按钮,谁有权说不。我觉得这非常合理。”

【9】“左翼觉醒公司”标签:Anthropic 一直刻意保持政治中立

采访者直接引用了特朗普的定性:“特朗普称 Anthropic 是'左翼觉醒公司'。这个决定是意识形态驱动的吗?”

Amodei 列举了一系列合作记录来反驳:他参加了特朗普和参议员 McCormick 在宾夕法尼亚州举办的能源活动,讨论为 AI 模型提供充足电力供应;Anthropic 签署了 AI 健康应用承诺;当政府的 AI 行动计划发布时,Anthropic 公开表示同意其中“许多甚至大部分内容”。

“Anthropic 只在 AI 政策领域发声,因为这是我们有专业能力的领域。我们不参与一般性的政治议题。这种认为我们不够公正的说法——我们一直在刻意保持公正。”

他补充说:“我们无法控制别人——哪怕是总统——对我们的看法。我们能控制的是:保持理性,保持中立,坚持我们的信念。”

【10】推文治国:没有正式通知,只有社交媒体帖子

采访者问 Anthropic 是否会采取法律行动。Amodei 说:"我们收到的只是一条推文。我们没有收到任何正式信息。没有实际的供应链定性文件。政府没有采取任何实际行动。只有推文说他们声称将要做什么。"

一家价值数百亿美元的美国科技公司,一个影响整个国防 AI 生态的决定,居然是通过社交媒体帖子来传达的。没有正式文件,没有法律程序,没有直接沟通。

“当我们收到某种正式行动时,我们会审视它,理解它,然后在法庭上挑战它。”

他还指出了 Hegseth 推文中一个重要的法律细节:Hegseth 声称“任何与军方做生意的公司不能与 Anthropic 进行任何商业活动”,但法律实际上只规定,在军事合同范围内不能使用 Anthropic。这两者之间有巨大差异。Amodei 直言 Hegseth 的推文“旨在制造不确定性,旨在制造恐惧、不确定和怀疑”。

对于这是否构成“权力滥用”,Amodei 第一次回避了这个问题,只说“这是前所未有的”。采访者再次追问,他才给出了更明确的定性:这从未发生过,从未对美国公司做过,而且从政府的声明和用语中可以清楚看出,“这是报复性和惩罚性的。我不知道还能怎么称呼它。”

【11】能否达成协议——“红线不会动摇”

采访者问他用 1 到 10 打分,未来达成协议的可能性有多大。

Amodei 没有打分。他重申了 Anthropic 的立场:两条红线从第一天起就存在,不会改变。如果能和五角大楼达成共识,协议当然可以有。“为了美国国家安全,我们继续希望让这件事行得通。但达成协议需要双方。”

【12】如果能跟总统说话——“反对政府是世界上最美国的事”

采访者给了 Amodei 一个直接向总统喊话的机会:“如果现在能跟总统说话,你会说什么?”

他说:我们是爱国的美国人。我们做的一切都是为了这个国家、为了支持美国国家安全。我们率先将模型部署给军方,是因为我们相信这个国家。我们画红线,是因为跨越这些红线违背美国价值观,我们要捍卫美国价值观。

当面临供应链认定和《国防生产法》的威胁——这些是“政府对私营经济前所未有的侵入”,他说 Anthropic 行使了“经典的第一修正案权利来表达异议”。

反对政府是世界上最美国的事,而我们在这件事上所做的一切都是爱国行为。

(“Disagreeing with the government is the most American thing in the world, and we are patriots in everything we have done here. We have stood up for the values of this country.”)

【13】商业生存——“不仅能存活,我们会很好”

采访者问出了投资者和客户最关心的问题:“你认为 Anthropic 能否作为一家企业存活下来?”

Amodei 说,供应链认定的实际影响范围远没有 Hegseth 推文暗示的那么大。"国防部长推文的目的是制造不确定性、制造恐惧,让人们认为影响会比实际大得多。但我们不会让这种策略得逞。我们会很好。"

【注:Anthropic 2026 年预计收入至少 180 亿美元,估值约 3800 亿美元。被取消的五角大楼合同价值 2 亿美元,占其收入比例很小。但更大的风险来自供应链认定可能带来的连锁反应——大量与五角大楼有业务往来的企业客户可能出于风险规避而减少使用 Claude。】

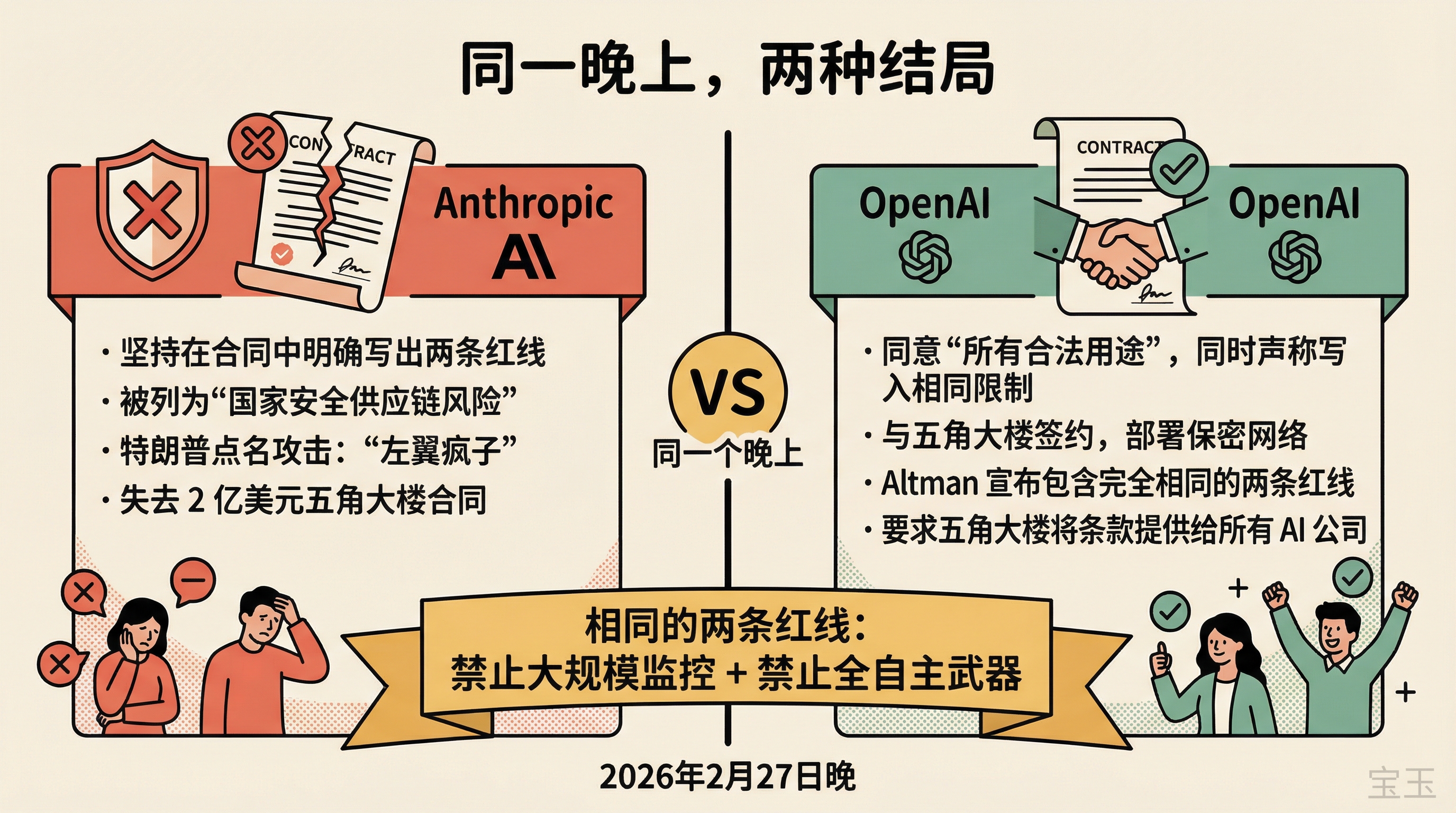

【14】最大的讽刺:OpenAI 同一晚上拿到了相同的条款

就在同一个晚上,事情出现了转折。

就在 Anthropic 因坚持两条红线而被“拉黑”的几个小时后,OpenAI CEO Sam Altman 在 X 上宣布,OpenAI 已与五角大楼达成协议,将在保密网络上部署其模型。关键在于 Altman 声称的条款。他写道:"我们最重要的两项安全原则是禁止国内大规模监控和人类对使用武力的责任,包括对自主武器系统的责任。战争部同意这些原则,在法律和政策中体现了这些原则,并且我们把它们写入了我们的协议。"

这与 Anthropic 被惩罚的理由完全相同。

多家媒体指出了这个矛盾。CNN 报道称“目前不清楚 OpenAI 的协议与 Anthropic 想要的有什么不同”。Fortune 的分析更加尖锐:关键区别可能在于措辞方式——Anthropic 试图在合同中明确写出这些限制,而 OpenAI 同意五角大楼可以将其技术用于“任何合法目的”,同时 Altman“也说将这些限制写入了协议”。两者如何同时成立,“不得而知”。

Axios 的报道提供了另一个视角:一位知情人士透露,OpenAI 协议中的限制“反映的是现有美国法律和五角大楼的政策”,意图不是“发明新的法律标准”。而 Anthropic 的核心关切恰恰在于——现有法律已经跟不上 AI 的能力了。

R Street Institute 的分析师 Mark Dalton 指出了五角大楼立场的一个根本性矛盾:本周早些时候,他们认为 Anthropic 的技术对国家安全如此重要,以至于考虑动用《国防生产法》来强制获取;而现在突然又说它是“供应链风险”。一个东西不能既是“不可或缺的国家安全资产”又是“供应链风险”,除非真正的问题是谁有权说“不”。

Altman 在帖子末尾还加了一句意味深长的话:“我们要求战争部将同样的条款提供给所有 AI 公司,我们认为每家公司都应该愿意接受这些条款。”

这场冲突的余波还远未平息。

Anthropic 表示将在法庭上挑战供应链风险的定性。超过 430 名 Google 和 OpenAI 的员工签署了公开信支持 Anthropic 的立场,呼吁行业团结。Google DeepMind 首席科学家 Jeff Dean 个人表态反对政府大规模监控。但 xAI 的 Elon Musk 站在政府一边,声称“Anthropic 仇恨西方文明”。

这场争论已经超越了一纸合同或一家公司的命运。正如 Amodei 在访谈中反复说的:当 AI 的能力跑到了法律前面,当算法可以做到宪法制定者从未想象过的事情,谁来守住底线?

OpenAI 在同一个晚上获得了包含相同限制的合同,连五角大楼最终也同意了这两条红线。真正的问题是:一家公司是否有权在谈判桌上说“不”,还是必须无条件服从。

Amodei 选择了说“不”。代价是一份 2 亿美元的合同、一个“供应链风险”的标签,以及总统在社交媒体上的点名攻击。他说 Anthropic 会没事的。时间会告诉我们答案。